美国知名密码器公司遭遇AI声音克隆诈骗

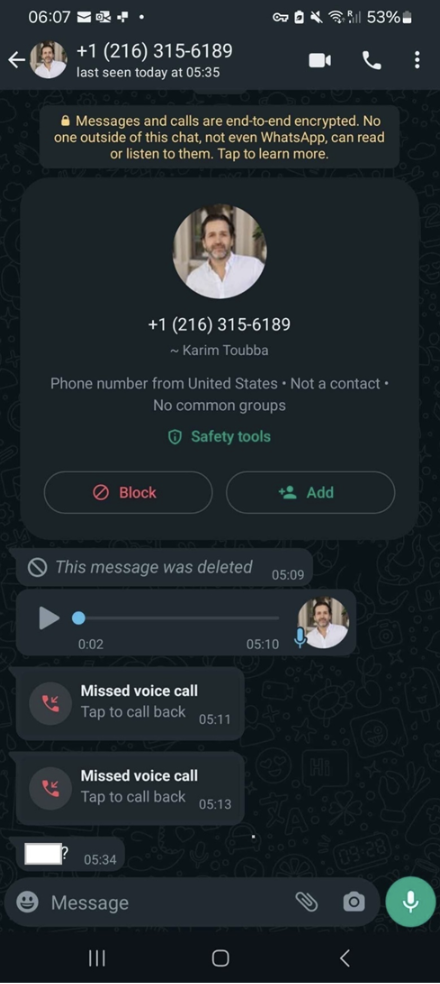

2024年4月10日,密码管理工具公司LastPass通过官方博客,披露一起通过Deepfake伪造该公司首席执行官卡里姆·图巴(Karim Toubba)的诈骗,警告公众要警惕 AI 生成的诈骗电话。

根据博客描述,一个骗子冒充LastPass首席执行官卡里姆·图巴(Karim Toubba)创建了一个WhatsApp账户。然后,该欺诈者向码管理工具公司LastPass员工接员发送一系列消息,包括使用AI的伪造的卡里姆·图巴声音的语音消息,多条未接的音频通话等。以营造出“事件的强迫紧迫性”,迫使员工相信这是CEO卡里姆·图巴的真实来电。基于社会工程策略的网络犯罪通常依赖于制造紧迫感或恐慌感,迫使受害者做出仓促的决定。

不过,该员工很快就识别出这是骗子伪造的电话。因为,WhatsApp并不是码管理工具公司LastPass内部常用的沟通工具,再有语音消息提到事项突破该员工的常识理解。该员工立即向LastPass安全部门报告该事件。随后,LastPass通告了该事件,并确认此次攻击并未影响其整体安全态势。

该欺诈事件凸显出,AI技术的普及下的声音伪造,让网络犯罪欺诈变得愈加复杂。此外,也体现出员工意识培训在减轻此类攻击方面的重要性。

这种未遂骗局继续表明网络犯罪分子的攻击变得多么复杂。另一方面,LastPass强调了员工意识培训在减轻此类攻击方面的重要性。社会工程策略通常依赖于制造紧迫感或恐慌感,迫使受害者做出仓促的决定。

基于AI的语音克隆,可以为有语言障碍的人生成合成语音,但是更可能成为诈骗分子的牟利工具。针对AI的语音克隆欺诈,顶象防御云业务安全情报中心建议可以在如下几个方面进行防御和防范。

1、声音采集增加多维度声音。增加声音的更多维度信息。录制音频的硬件增加内置传感器,用于检测和测量人体在说话时发出的生物信号,例如心跳、肺运动、声带振动以及嘴唇、下巴和舌头的运动,录制的声音能够附加到音频上,并为听众提供可验证的信息,以分别语音是自然录制还是AI伪造。

2、AI语音融合工具内置不可抹除的水印。AI声音合成工具增加不可删除的声音水印,例如,微小的扰动、杂乱无章的噪音、固定的某个背景节奏等,使听到的人能够辨别出来。

3、设置“安全词”。提前设置好一个“安全词”,告知亲朋好友和同事、伙伴,如果接到可疑的电话,要求对方提供这个“安全词”。如果对方无法提供或回避,那么能够在第一时间识别出虚假诈骗电话,避免陷入恐慌。

4、接受者收到后挂断并重拨电话。当受害人接到可疑的电话时,可以表现得信号不好,然后挂断电话并立即回拨被冒充者的号码进行确认。

总之,当受害人收到声音克隆诈骗,除了采取有效的防范和应对措施外,保持冷静和警惕至关重要的。此外,及时报警并与警方合作是打击这种犯罪行为的关键。

微信公众号

微信公众号 微信视频号

微信视频号